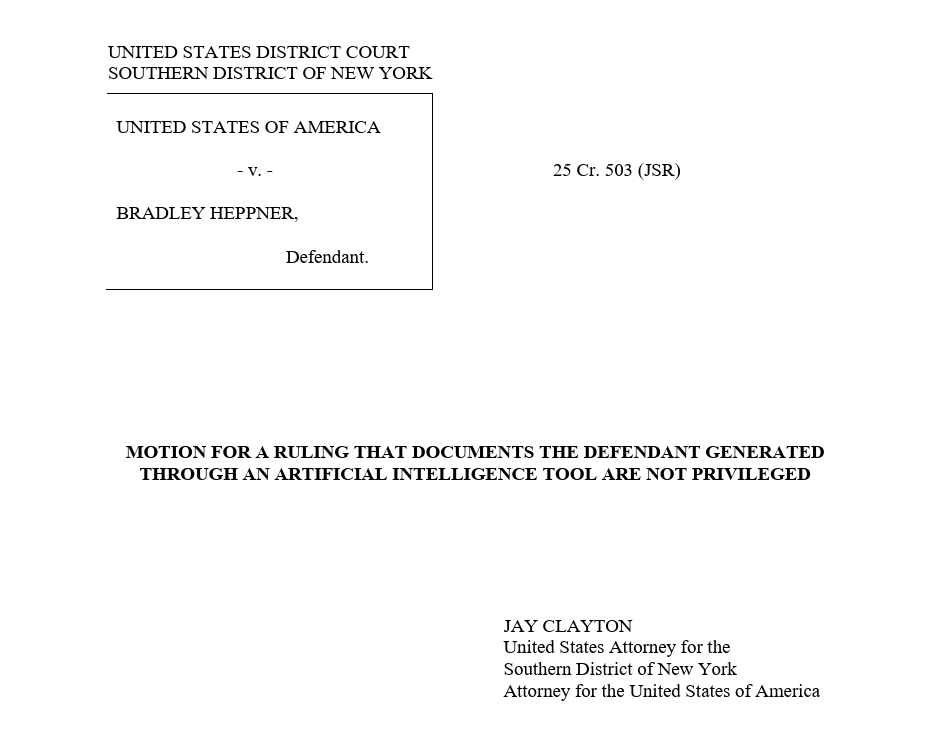

Решение федерального судьи в Нью-Йорке, отказавшегося признавать адвокатскую тайну в отношении документов, созданных с помощью искусственного интеллекта, на первый взгляд выглядит частной юридической деталью. Обвиняемый подготовил стратегию защиты через публичную систему ИИ, а затем передал материалы адвокату. Суд указал: привилегия не действует, поскольку информация была раскрыта третьей стороне — сервису, не связанному режимом профессиональной тайны.

Формула проста. И она разрушительна.

Если в создании документа участвовала внешняя инфраструктура, юридическая защита может быть утрачена.

Проблема в том, что этот прецедент — не про адвокатов. Он про всех.

Сегодня к ИИ обращаются не только пациенты, обсуждающие симптомы. К ИИ обращаются врачи. К ИИ обращаются юристы. К ИИ обращаются государственные служащие. К ИИ обращаются топ-менеджеры. Причём обращаются не в абстрактных ситуациях, а в процессе реальной работы — с черновиками решений, медицинскими данными, проектами нормативных актов, аналитическими записками, внутренними служебными документами.

Каждый такой диалог — это передача информации внешнему посреднику.

Пока право ещё не дало универсального ответа, но логика суда предельно ясна: если данные прошли через систему, которая не является носителем профессиональной обязанности хранить тайну, возникает третья сторона. А третья сторона разрушает привилегию.

Врач, который консультируется с ИИ по сложному случаю, может считать, что он просто использует современный инструмент. Но юридически ситуация выглядит иначе. Если данные пациента — даже обезличенные — передаются через публичный сервис, который регулируется пользовательским соглашением, а не режимом врачебной тайны, возникает новая зона риска. Пациент вправе задать вопрос: была ли соблюдена конфиденциальность? И если ответ окажется неочевидным, судебная перспектива становится реальной.

Парадокс в том, что врачебная тайна исторически строилась на доверии к личности врача и к институту медицинского учреждения. Сегодня между пациентом и врачом всё чаще появляется алгоритмический посредник. Он не связан клятвой, не несёт профессиональной ответственности в традиционном смысле и действует в рамках договора, который пациент чаще всего даже не видел.

Если суд в уголовном процессе уже признал, что участие публичного ИИ может разрушить адвокатскую привилегию, то в гражданской сфере логика может оказаться аналогичной. Представим иск пациента к врачу: использовались ли сторонние цифровые инструменты? Были ли данные переданы через сервис, не обеспечивающий строгий режим медицинской тайны? Соответствовали ли действия врача нормативным требованиям к защите персональных данных? Эти вопросы неизбежны. И они лавинообразны.

Проблема выходит далеко за пределы медицины.

Государственные служащие по всему миру используют ИИ для подготовки служебных записок, анализа отчётов, формулирования проектов решений. Иногда речь идёт о чувствительной информации, иногда — о документах, содержащих элементы государственной тайны или конфиденциальных данных. В большинстве случаев это происходит из практического удобства, без ощущения риска. Но если юридическая квалификация публичного ИИ как «третьей стороны» закрепится, возникнет фундаментальный конфликт между реальной административной практикой и формальным режимом секретности.

Мы живём в момент, когда инфраструктура мышления изменилась быстрее, чем правовые режимы защиты.

Пользователь воспринимает ИИ как интеллектуальный инструмент. Право рассматривает его как самостоятельного посредника. Пользователь ощущает приватность. Право видит договор. Пользователь думает, что пишет черновик. Право фиксирует передачу данных третьему субъекту.

В этом и заключается новая противозаконность мира. Не в том, что все сознательно нарушают закон. А в том, что повседневная практика массово вступает в конфликт с теми правовыми конструкциями, которые должны её регулировать.

Можно запретить использование данных для обучения модели. Можно выбрать корпоративный тариф. Можно прописать внутренние инструкции. Но если сам факт взаимодействия с внешней инфраструктурой юридически квалифицируется как раскрытие информации третьей стороне, возникает системная нестабильность.

Мы приближаемся к точке, где почти любой чувствительный документ проходит через цифрового посредника. Медицинские карты анализируются алгоритмами. Юридические стратегии формулируются через языковые модели. Государственные отчёты редактируются с помощью ИИ. И при этом правовой статус такого участия остаётся не до конца определённым.

Лавинообразность заключается в том, что достаточно нескольких судебных решений, чтобы началась волна исков. Пациенты против клиник. Клиенты против юридических фирм. Акционеры против менеджмента. Государство против собственных служащих. И во всех случаях ключевой вопрос будет одинаковым: кто ещё участвовал в создании документа?

Искусственный интеллект перестал быть нейтральным инструментом. Он стал инфраструктурой посредничества. А посредничество меняет юридический режим информации.

Мир не просто прозрачен. Он оказался противозаконным в структурном смысле. Нормы конфиденциальности остались прежними, а среда их применения изменилась радикально. Мы продолжаем говорить о тайне, как будто она существует автоматически. Но тайна в цифровую эпоху возможна только при специально созданном и юридически закреплённом режиме.

Пока такого режима нет, каждый диалог с публичным ИИ — это потенциальное раскрытие. Не намеренное, не злонамеренное, а встроенное в саму архитектуру технологии.

И в этом состоит главный вызов ближайших лет. Не борьба человека с машиной. А пересборка самой идеи защиты в мире, где третья сторона присутствует почти в каждом акте мышления.

Формула проста. И она разрушительна.

Если в создании документа участвовала внешняя инфраструктура, юридическая защита может быть утрачена.

Проблема в том, что этот прецедент — не про адвокатов. Он про всех.

Сегодня к ИИ обращаются не только пациенты, обсуждающие симптомы. К ИИ обращаются врачи. К ИИ обращаются юристы. К ИИ обращаются государственные служащие. К ИИ обращаются топ-менеджеры. Причём обращаются не в абстрактных ситуациях, а в процессе реальной работы — с черновиками решений, медицинскими данными, проектами нормативных актов, аналитическими записками, внутренними служебными документами.

Каждый такой диалог — это передача информации внешнему посреднику.

Пока право ещё не дало универсального ответа, но логика суда предельно ясна: если данные прошли через систему, которая не является носителем профессиональной обязанности хранить тайну, возникает третья сторона. А третья сторона разрушает привилегию.

Врач, который консультируется с ИИ по сложному случаю, может считать, что он просто использует современный инструмент. Но юридически ситуация выглядит иначе. Если данные пациента — даже обезличенные — передаются через публичный сервис, который регулируется пользовательским соглашением, а не режимом врачебной тайны, возникает новая зона риска. Пациент вправе задать вопрос: была ли соблюдена конфиденциальность? И если ответ окажется неочевидным, судебная перспектива становится реальной.

Парадокс в том, что врачебная тайна исторически строилась на доверии к личности врача и к институту медицинского учреждения. Сегодня между пациентом и врачом всё чаще появляется алгоритмический посредник. Он не связан клятвой, не несёт профессиональной ответственности в традиционном смысле и действует в рамках договора, который пациент чаще всего даже не видел.

Если суд в уголовном процессе уже признал, что участие публичного ИИ может разрушить адвокатскую привилегию, то в гражданской сфере логика может оказаться аналогичной. Представим иск пациента к врачу: использовались ли сторонние цифровые инструменты? Были ли данные переданы через сервис, не обеспечивающий строгий режим медицинской тайны? Соответствовали ли действия врача нормативным требованиям к защите персональных данных? Эти вопросы неизбежны. И они лавинообразны.

Проблема выходит далеко за пределы медицины.

Государственные служащие по всему миру используют ИИ для подготовки служебных записок, анализа отчётов, формулирования проектов решений. Иногда речь идёт о чувствительной информации, иногда — о документах, содержащих элементы государственной тайны или конфиденциальных данных. В большинстве случаев это происходит из практического удобства, без ощущения риска. Но если юридическая квалификация публичного ИИ как «третьей стороны» закрепится, возникнет фундаментальный конфликт между реальной административной практикой и формальным режимом секретности.

Мы живём в момент, когда инфраструктура мышления изменилась быстрее, чем правовые режимы защиты.

Пользователь воспринимает ИИ как интеллектуальный инструмент. Право рассматривает его как самостоятельного посредника. Пользователь ощущает приватность. Право видит договор. Пользователь думает, что пишет черновик. Право фиксирует передачу данных третьему субъекту.

В этом и заключается новая противозаконность мира. Не в том, что все сознательно нарушают закон. А в том, что повседневная практика массово вступает в конфликт с теми правовыми конструкциями, которые должны её регулировать.

Можно запретить использование данных для обучения модели. Можно выбрать корпоративный тариф. Можно прописать внутренние инструкции. Но если сам факт взаимодействия с внешней инфраструктурой юридически квалифицируется как раскрытие информации третьей стороне, возникает системная нестабильность.

Мы приближаемся к точке, где почти любой чувствительный документ проходит через цифрового посредника. Медицинские карты анализируются алгоритмами. Юридические стратегии формулируются через языковые модели. Государственные отчёты редактируются с помощью ИИ. И при этом правовой статус такого участия остаётся не до конца определённым.

Лавинообразность заключается в том, что достаточно нескольких судебных решений, чтобы началась волна исков. Пациенты против клиник. Клиенты против юридических фирм. Акционеры против менеджмента. Государство против собственных служащих. И во всех случаях ключевой вопрос будет одинаковым: кто ещё участвовал в создании документа?

Искусственный интеллект перестал быть нейтральным инструментом. Он стал инфраструктурой посредничества. А посредничество меняет юридический режим информации.

Мир не просто прозрачен. Он оказался противозаконным в структурном смысле. Нормы конфиденциальности остались прежними, а среда их применения изменилась радикально. Мы продолжаем говорить о тайне, как будто она существует автоматически. Но тайна в цифровую эпоху возможна только при специально созданном и юридически закреплённом режиме.

Пока такого режима нет, каждый диалог с публичным ИИ — это потенциальное раскрытие. Не намеренное, не злонамеренное, а встроенное в саму архитектуру технологии.

И в этом состоит главный вызов ближайших лет. Не борьба человека с машиной. А пересборка самой идеи защиты в мире, где третья сторона присутствует почти в каждом акте мышления.

ОЛИВА ПРЕСС, Евгений Лисиченко